使用 LLM + MCP 在过早客论坛冲浪🏄♀️

想法

作为一名开发者,我经常需要了解过早客论坛的讨论动态,但每次都要手动浏览很麻烦。能不能让AI助手直接帮我获取和分析论坛内容呢?

例如,问 AI:

今天过早客最热的话题是什么? AI 答:

今天讨论最热烈的话题是【武汉地铁票价调整】,共有128条回复。 主要观点分为三类: 1. 觉得涨价合理(运营成本压力) 2. 强烈反对(影响日常出行) 3. 建议差异化票价 是不是比自己一页页刷省事多了?

于是我开发了 guozaoke-mcp-server —— 首个专门用于过早客论坛的MCP服务器。现在,你可以直接问LLM:"请帮我看看过早客论坛今天的热门话题",它就能实时获取并分析论坛内容。

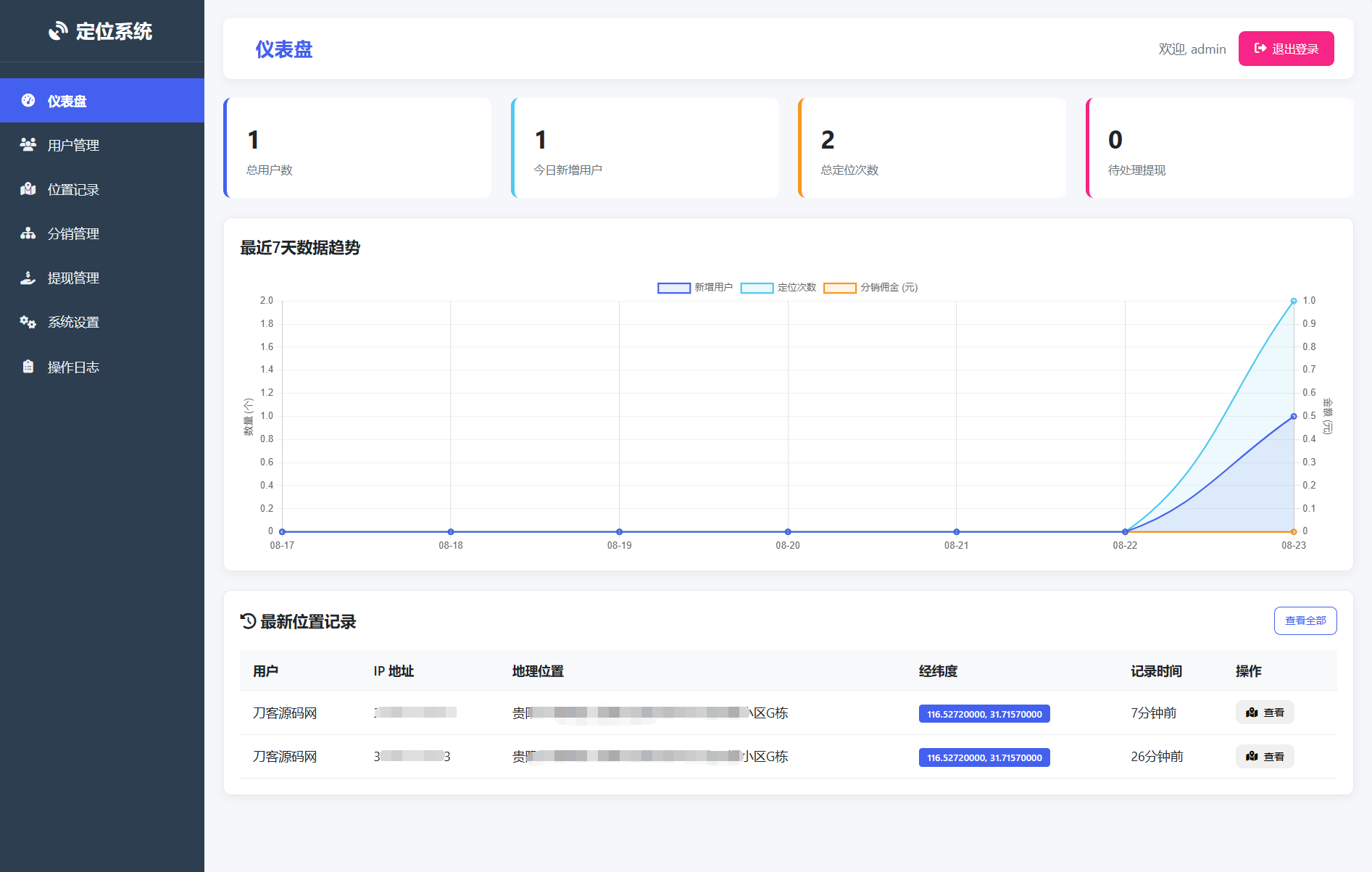

实际效果

什么是MCP

Model Context Protocol (MCP)

是 Anthropic 提出的一个标准协议(基于 JSON RPC),作用是让LLM能标准化地访问外部数据。本文场景下,传统方式 vs MCP方式:

传统:用户 → 浏览器 → 论坛网站 → 人工分析 MCP:用户 → LLM → MCP服务器 → 论坛网站 → 智能分析 guozaoke-mcp-server核心功能:两个Tools

1. 话题列表获取

// 用户问:"过早客最新有什么话题?" // AI调用:fetch-guozaoke-topic-list // 返回:结构化的话题数据 支持分页浏览,解析HTML转为JSON格式,方便AI理解和处理。

2. 话题详情获取

// 用户问:"帮我看看第3个话题的详细讨论" // AI调用:fetch-guozaoke-topic-details // 返回:完整的帖子内容和所有回复 支持检测登录状态,支持Cookie认证访问需要权限的内容。

快速开始

{ "mcpServers": { "guozaoke-mcp-server": { "type": "stdio", "command": "npx", "args": [ "-y", "guozaoke-mcp-server" ], "env": { "GUOZAOKE_COOKIE": "..." } } } } 项目地址:GitHub | NPM

这一切,似未曾拥有